English | 中文

微软VALL-E X 零样本语音合成模型的开源实现.

预训练模型现已向公众开放,供研究或应用使用。

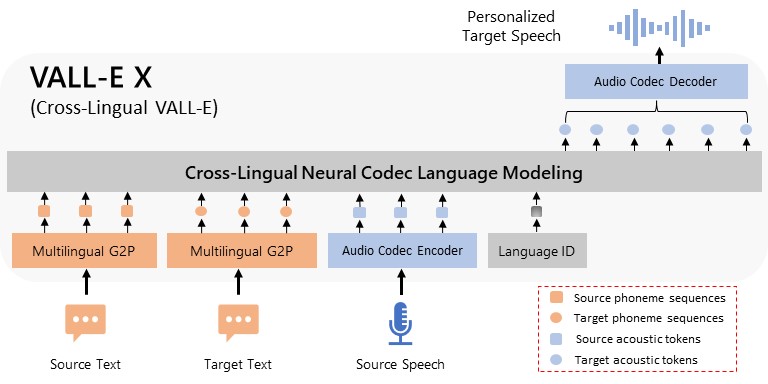

VALL-E X 是一个强大而创新的多语言文本转语音(TTS)模型,最初由微软发布。虽然微软最初在他们的研究论文中提出了该概念,但并未发布任何代码或预训练模型。我们认识到了这项技术的潜力和价值,复现并训练了一个开源可用的VALL-E X模型。我们很乐意与社区分享我们的预训练模型,让每个人都能体验到次世代TTS的威力。 🎧

更多细节请查看 model card.

2023.08.24

- 如果无法访问Google Drive,请从Hugging Face链接下载模型权重,并将其放在

./checkpoints/文件夹中。

2023.08.23

- 加入了长文本生成功能

2023.08.20

- 加入了中文版README

2023.08.14

- 预训练模型权重已发布,从这里下载。

git clone https://github.com/Plachtaa/VALL-E-X.git

cd VALL-E-X

pip install -r requirements.txt

注意:如果需要制作prompt,需要安装 ffmpeg 并将其所在文件夹加入到环境变量PATH中

如果你不想在本地安装,你可以在线体验VALL-E X的功能,点击下面的任意一个链接即可开始体验。

VALL-E X 配备有一系列尖端功能:

-

多语言 TTS: 可使用三种语言 - 英语、中文和日语 - 进行自然、富有表现力的语音合成。

-

零样本语音克隆: 仅需录制任意说话人的短短的 3~10 秒录音,VALL-E X 就能生成个性化、高质量的语音,完美还原他们的声音。

- 语音情感控制: VALL-E X 可以合成与给定说话人录音相同情感的语音,为音频增添更多表现力。

- 零样本跨语言语音合成: VALL-E X 可以合成与给定说话人母语不同的另一种语言,在不影响口音和流利度的同时,保留该说话人的音色与情感。以下是一个使用日语母语者进行英文与中文合成的样例: 🇯🇵 🗣

- 口音控制: VALL-E X 允许您控制所合成音频的口音,比如说中文带英语口音或反之。 🇨🇳 💬

- 声学环境保留: 当给定说话人的录音在不同的声学环境下录制时,VALL-E X 可以保留该声学环境,使合成语音听起来更加自然。

你可以访问我们的demo页面 来浏览更多示例!

from utils.generation import SAMPLE_RATE, generate_audio, preload_models

from scipy.io.wavfile import write as write_wav

from IPython.display import Audio

# download and load all models

preload_models()

# generate audio from text

text_prompt = """

Hello, my name is Nose. And uh, and I like hamburger. Hahaha... But I also have other interests such as playing tactic toast.

"""

audio_array = generate_audio(text_prompt)

# save audio to disk

write_wav("vallex_generation.wav", SAMPLE_RATE, audio_array)

# play text in notebook

Audio(audio_array, rate=SAMPLE_RATE)hamburger.webm

该VALL-E X实现支持三种语言:英语、中文和日语。您可以通过设置`language`参数来指定语言。默认情况下,该模型将自动检测语言。

text_prompt = """

チュソクは私のお気に入りの祭りです。 私は数日間休んで、友人や家族との時間を過ごすことができます。

"""

audio_array = generate_audio(text_prompt)vallex_japanese.webm

注意:即使在一句话中混合多种语言的情况下,VALL-E X也能完美地控制口音,但是您需要手动标记各个句子对应的语言以便于我们的G2P工具识别它们。

text_prompt = """

[EN]The Thirty Years' War was a devastating conflict that had a profound impact on Europe.[EN]

[ZH]这是历史的开始。 如果您想听更多,请继续。[ZH]

"""

audio_array = generate_audio(text_prompt, language='mix')vallex_codeswitch.webm

我们提供十几种说话人音色可直接VALL-E X使用! 在这里浏览所有可用音色。

VALL-E X 尝试匹配给定预设音色的音调、音高、情感和韵律。该模型还尝试保留音乐、环境噪声等。

text_prompt = """

I am an innocent boy with a smoky voice. It is a great honor for me to speak at the United Nations today.

"""

audio_array = generate_audio(text_prompt, prompt="dingzhen")smoky.webm

VALL-E X 支持声音克隆!你可以使用任何人,角色,甚至是你自己的声音,来制作一个音频提示。在你使用该音频提示时,VALL-E X 将会使用与其相似的声音来合成文本。

你需要提供一段3~10秒长的语音,以及该语音对应的文本,来制作音频提示。你也可以将文本留空,让Whisper模型为你生成文本。

VALL-E X 尝试匹配给定音频提示的音调、音高、情感和韵律。该模型还尝试保留音乐、环境噪声等。

from utils.prompt_making import make_prompt

### Use given transcript

make_prompt(name="paimon", audio_prompt_path="paimon_prompt.wav",

transcript="Just, what was that? Paimon thought we were gonna get eaten.")

### Alternatively, use whisper

make_prompt(name="paimon", audio_prompt_path="paimon_prompt.wav")来尝试一下刚刚做好的音频提示吧!

text_prompt = """

Hey, Traveler, Listen to this, This machine has taken my voice, and now it can talk just like me!

"""

audio_array = generate_audio(text_prompt, prompt="paimon")

write_wav("paimon_cloned.wav", SAMPLE_RATE, audio_array)paimon_prompt.webm

paimon_cloned.webm

如果你不擅长代码,我们还为VALL-E X创建了一个用户友好的图形界面。它可以让您轻松地与模型进行交互,使语音克隆和多语言语音合成变得轻而易举。

使用以下命令启动用户界面:

python launch-ui.py

VALL-E X 可以在CPU或GPU上运行 (pytorch 2.0+, CUDA 11.7 ~ CUDA 12.0).

若使用GPU运行,你需要至少6GB的显存。

VALL-E X 与 Bark, VALL-E and AudioLM类似, 使用GPT风格的模型以自回归方式预测量化音频token,并由EnCodec解码.

与 Bark 相比:

- ✔ 轻量: 3️⃣ ✖ smaller,

- ✔ 快速: 4️⃣ ✖ faster,

- ✔ 中文&日文的更高质量

- ✔ 跨语言合成时没有外国口音

- ✔ 开放且易于操作的声音克隆

- ❌ 支持的语言较少

- ❌ 没有用于合成音乐及特殊音效的token

| Language | Status |

|---|---|

| English (en) | ✅ |

| Japanese (ja) | ✅ |

| Chinese, simplified (zh) | ✅ |

- We use

gdownto download the model to directory./checkpoints/when you runpreload_models()for the first time.

- 6GB GPU VRAM - Almost all NVIDIA GPUs satisfy the requirement.

- Transformer's computation complexity increases quadratically while the sequence length increases. Hence, all training are kept under 22 seconds. Please make sure the total length of audio prompt and generated audio is less than 22 seconds to ensure acceptable performance.

- To generate long text, a huge paragraph must be breakdown into short sentences. We are currently working on this.

- Add Chinese README

-

.batscripts for non-python users - Long text generation

- Fine-tuning for better voice adaptation

- Replace Encodec decoder with Vocos decoder

- To be added...

- VALL-E X paper for the brilliant idea

- lifeiteng's vall-e for related training code

- bark for the amazing pioneering work in neuro-codec TTS model

If you find VALL-E X interesting and useful, give us a star on GitHub! ⭐️ It encourages us to keep improving the model and adding exciting features.

VALL-E X 使用 MIT License.

Have questions or need assistance? Feel free to open an issue or join our Discord

Happy voice cloning! 🎤