本项目是一个通过 mlc-llm 编译过的可以直接运行的android app, 具有运行本地部署的大模型进行对话的能力。

git lfs install

git clone https://github.com/QQQQQQY/MLCChat.git-

编译运行app 将生成的 apk 文件安装到手机上。

这个时候打开安装完成的app, 会发现列表中没有模型, 这是因为我们还没有配置好模型。而且会出现一个要求去下载模型的弹窗, 弹窗我们关闭掉就行。

-

将项目中的 gemma-2-2b-it-q4f16_1-MLC 整个目录复制到手机中的

/Android/data/ai.mlc.mlcchat/files目录下 复制完成后的目录结构如下:Android └── data └── ai.mlc.mlcchat └── files └── gemma-2-2b-it-q4f16_1-MLC ├── mlc-chat-config.json ├── ... └── ... -

重新打开 app, 这个时候我们就能看到模型列表了。

-

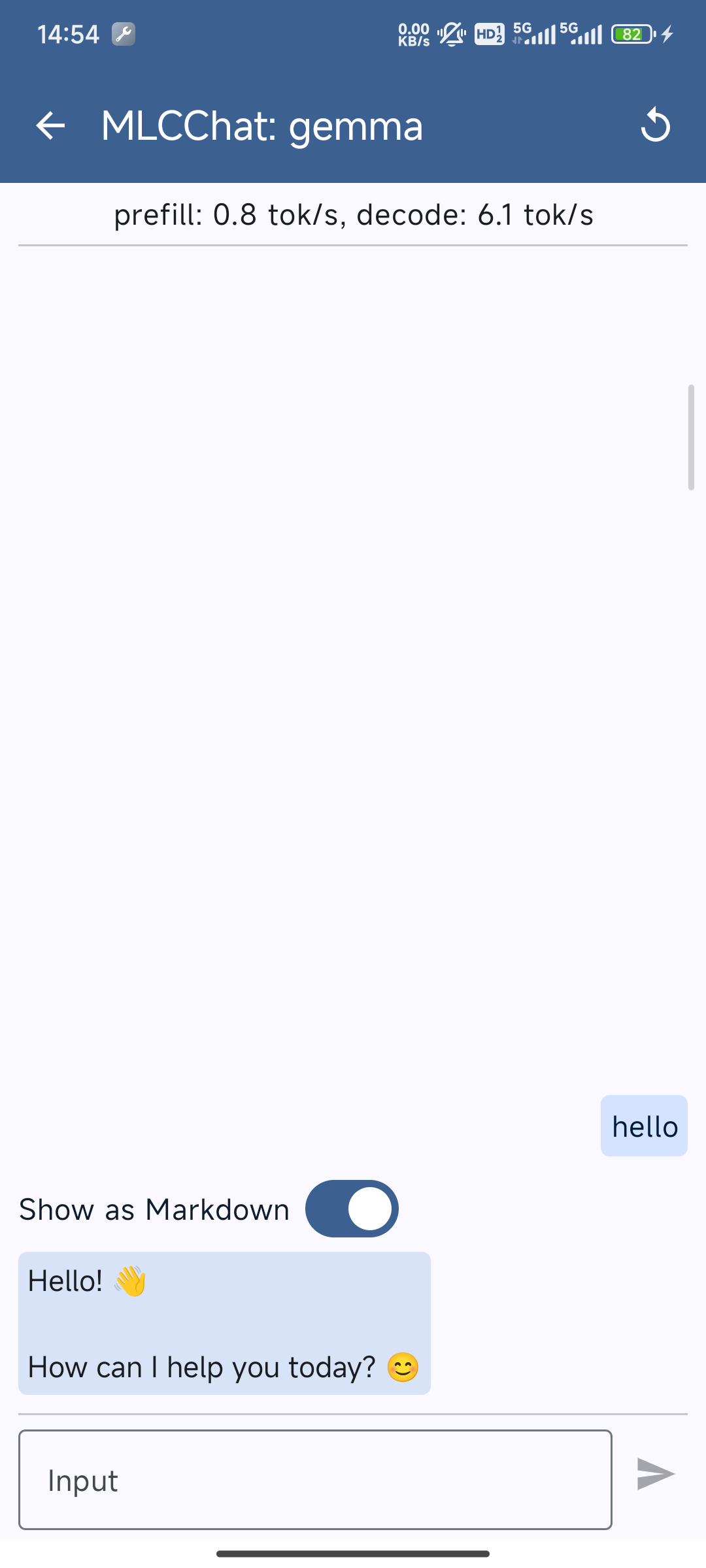

等待初始化完成, 这个时候我们就可以开始使用本地大模型进行对话了。

-

本项目默认配置了

gemma-2-2b-it-q4f16_1-MLC模型,如果你想使用其他的模型, 可以按照下面步骤:

- 在 hf-mirror 下载你需要配置的其他模型, 注意:

需要是转换过权重的以

-MLC结尾的模型。 - 修改 mlc-app-config.json 文件, 将你下载的模型配置进去。

- 重新编译运行 app。

- 复制你下载的大模型到手机中的

/Android/data/ai.mlc.mlcchat/files目录下。 - 重新打开 app, 这个时候我们就能看到新添加的模型了。

- 在 hf-mirror 下载你需要配置的其他模型, 注意:

需要是转换过权重的以