🚀 项目简介

KrillinAI是一个为追求高质量视频翻译的用户和开发者设计的解决方案,提供从视频下载到最终成品的一站式工作流程,用AI赋能跨语言文化沟通。

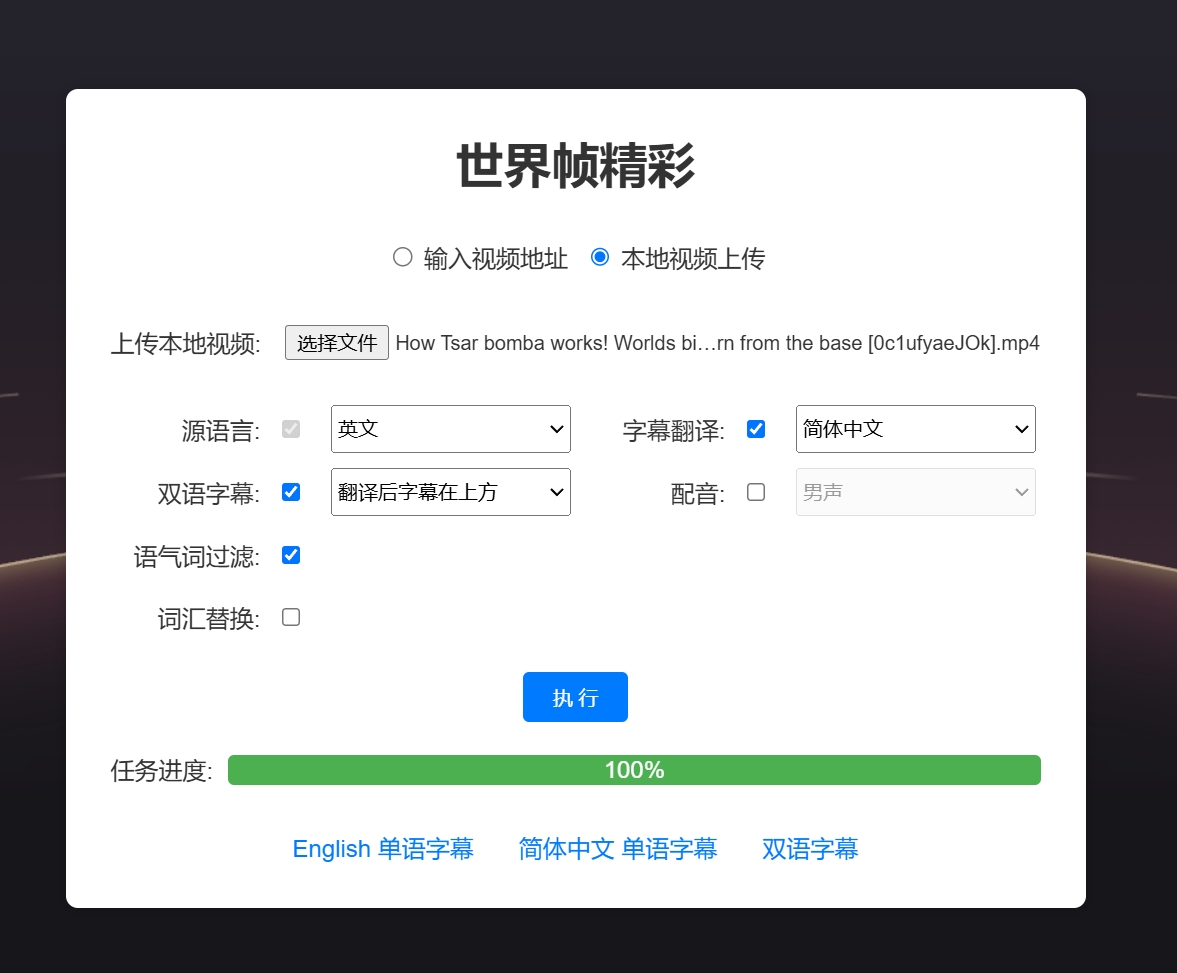

🎯 一键启动:无需复杂的环境配置,Krillin AI支持自动安装依赖,快速上手,立即投入使用

📥 视频获取:集成yt-dlp,直接通过YouTube,Bilibili链接下载视频,简化素材收集过程,也可直接上传本地视频

📜 字幕识别和翻译:支持OpenAI、阿里云等主流供应商的语音和大模型服务以及Faster Whisper本地模型(持续集成中)

🧠 智能字幕分割对齐:利用自研算法对字幕进行智能分割和对齐,摆脱生硬的断句

🔄 自定义词汇替换:支持一键替换词汇,适应特定领域语言风格

🌍 专业级翻译:整段翻译引擎,确保上下文一致和语义连贯

🎙️ 配音和声音克隆:可选默认的男女生音色生成翻译后的视频朗读配音,或者上传本地音频样本克隆音色进行朗读

📝 配音对齐:跨语言配音,也能与原字幕对齐

输入语言支持:🇨🇳中文,🇺🇸英文,🇯🇵日语(持续增加中)

翻译语言支持:英文,中文,俄语,西班牙语,法语等56种语言,还支持翻译成拼音

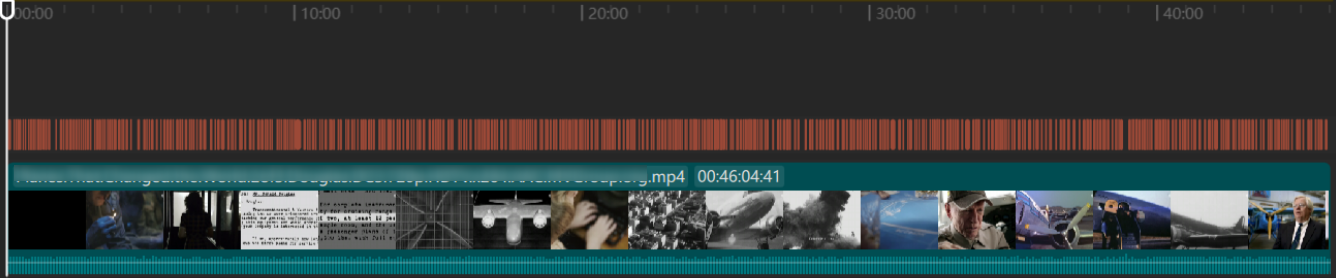

下图为46分钟的本地视频导入,一键执行后生成的字幕文件入轨后的效果,无任何手动调整。无缺失、重叠,断句自然,翻译质量也非常高。

subtitle_translation.mp4 |

tts.mp4 |

- 下载Release中与你设备系统匹配的可执行文件,放入空文件夹

- 在文件夹内创建

config文件夹,然后在config文件夹创建config.toml文件,复制源代码config目录下的config-example.toml文件的内容填入config.toml,并对照填写你的配置信息。 - 双击,或在终端执行可执行文件,启动服务

- 打开浏览器,输入

http://127.0.0.1:8888,开始使用 (8888替换成你在配置文件中填写的端口)

本软件没有做签名,因此在macOS上运行时,在完成“基本步骤”中的文件配置后,还需要手动信任应用,方法如下:

- 在终端打开可执行文件(假设文件名是KrillinAI-v1.0.0-windows)所在目录

- 依次执行以下命令:

即可启动服务

sudo xattr -rd com.apple.quarantine ./KrillinAI-v1.0.0-windows sudo chmod +x ./KrillinAI-v1.0.0-windows ./KrillinAI-v1.0.0-windows

如果你遇到视频下载失败的情况

请参考 Cookie 配置说明 配置你的Cookie信息。

最快速便捷的配置方式:

transcription_provider和llm_provider都选择openai,这样在下方openai、local_model、aliyun三个配置项大类里只需要填写openai.apikey就可以进行字幕翻译。(app.proxy和openai.base_url按自己情况选填)

使用本地语言识别模型(暂不支持macOS)的配置方式(兼顾成本、速度与质量的选择)

transcription_provider填写fasterwhisper,llm_provider填写openai,这样在下方openai、local_model三个配置项大类里只需要填写openai.apikey和local_model.faster_whisper就可以进行字幕翻译,本地模型会自动下载。(app.proxy和openai.base_url同上)

以下几种使用情况,需要进行阿里云的配置:

- 如果

llm_provider填写了aliyun,需要使用阿里云的大模型服务,因此需要配置aliyun.bailian项的配置 - 如果

transcription_provider填写了aliyun,或者在启动任务时开启了“配音”功能,都需要使用阿里云的语音服务,因此需要填写aliyun.speech项的配置 - 如果开启了“配音”功能,同时上传了本地的音频做音色克隆,则还需要使用阿里云的OSS云存储服务,因此需要填写

aliyun.oss项的配置

阿里云配置帮助:阿里云配置说明

请移步常见问题

- 不要提交无用文件,如.vscode、.idea等,请善于使用.gitignore过滤

- 不要提交config.toml,而是使用config-example.toml提交